OpenAI 창업자가 일상과 업무에서 AI를 활용하는 법

요약 과정에서 카파시의 이전 유튜브, 인터넷 검색한 내용, 제가 아는 내용, 제 감상 등이 섞였기 때문에 실제 유튜브 내용과 1:1 매칭이 되지 않을 수 있습니다.

OpenAI의 공동창업자로 잘 알려진 AI 엔지니어 Andrej Karpathy가 일반인을 위한 AI 강의를 유튜브에 올리고 있습니다. 삼일절 연휴를 맞아 2월 28일에 올라온, 가장 최신 영상인 How I use LLMs 를 쭉 봤는데요. 삶에서 만나는 다양한 상황에서 카파시가 어떻게 LLM을 활용하는지 아주 잘 나와있었어요.

SNS에서 우연히 발견하여 한글 요약본도 읽어봤는데 아쉽게도 원본의 그 맛이 살짝 죽었더군요. 다양한 시각화 자료와 카파시의 실사용 예제들에 큰 가치가 있다고 느꼈는데 아무래도 요약본은 카파시의 '말'만 번역해서 요약한 것이니 정보값이 좀 떨어졌습니다.

그래서 (AI 도움 없이) 직접 요약한 주요 내용을 스샷과 함께 공유합니다. 재밌었던 건 카파시가 요즘 솔로지옥 시즌 4를 열심히 보고 있고, Custom GPTs와 Anki를 이용해 한국어 공부를 하고 있다는 점이었습니다. 왠지 모를 국뽕 한 모금.

참고로 카파시는 모든 내용을 Exclidraw에서 시각화하면서 예제와 함께 설명했는데, 전체 Exclidraw 파일 다운로드도 가능합니다.

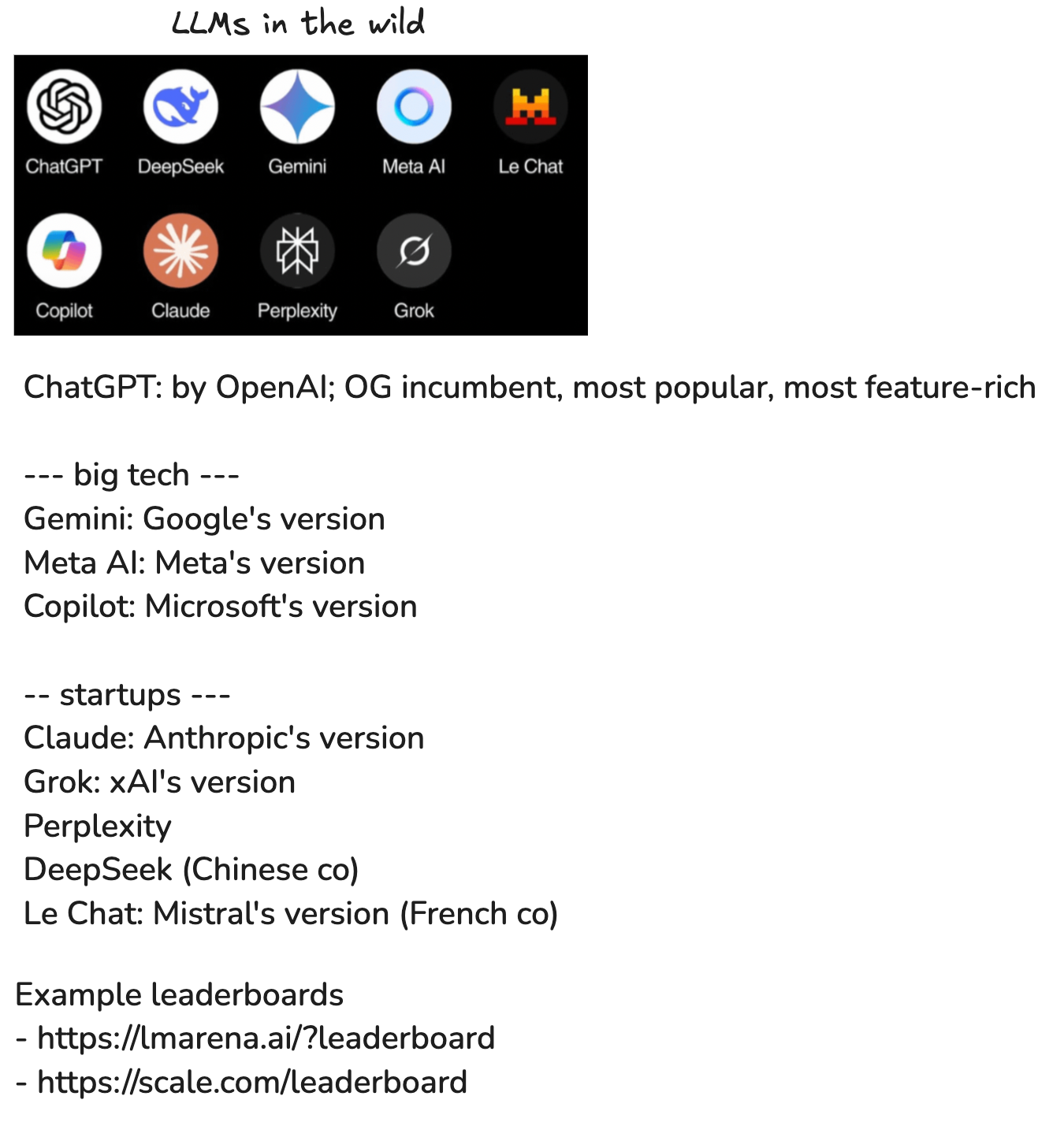

굉장히 여러 종류의 LLM이 있음

ChatGPT는 가장 유명하고, 가장 기능이 많음. 그 외에는 이런 것들이 유명함

- 구글의 Gemini

- Meta의 Meta AI

- MS의 Copilot

- Anthropic의 Claude

- xAI의 Grok

- Perplexity

- 중국의 DeepSeek

- 프랑스 Mistral의 Le Chat

ChatGPT는 어떻게 동작하는가

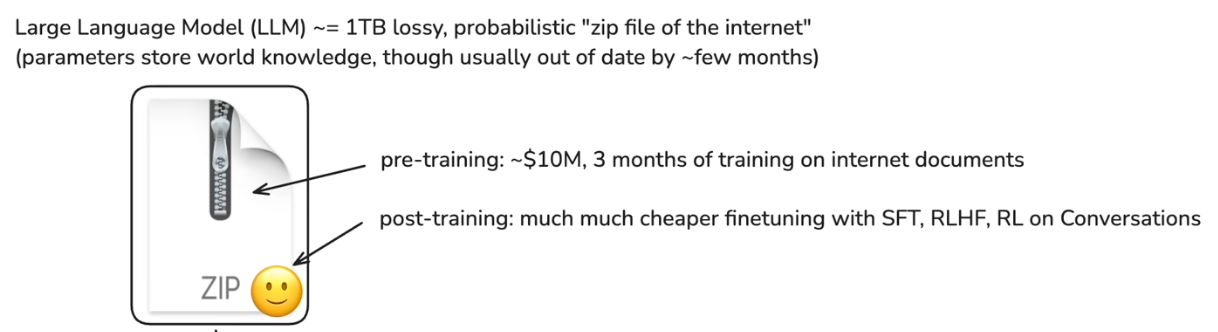

LLM은 인터넷 문서 전체를 1TB로 손실 압축한 zip 파일과 유사. 이 안에 수조 개의 파라미터가 있는 인공신경망이 있고 그게 '다음 글자'를 확률적으로 뱉어냄

이 압축파일은 크게 두 종류 학습을 해서 만듦

- 사전 학습: 수천만 달러 + 3개월 이상 듦. 비용 많이 드니까 자주 못하고, 그래서 knowldge cutoff가 생김

- 즉 압축파일 내의 지식이 최신이 아님. 대개 수개월 이상의 격차가 있음

- 이 격차가 (특히 초기 LLM에서) 환각의 주 원인이기도 함. Search, Knowledge 등 여러 기법으로 극복하고 있음

- 사후 학습: 훨씬 저비용으로 파인튜닝. 단순히 인터넷 문서를 뱉어주는 게 아니라 사용자의 질문에 답하는 Assistant로서 처럼 동작하게 만듦

- 모범답안을 알려주는 지도학습(Supervised Fine-Tuning)

- 생성된 답안에 대한 인간의 선호를 토대로 한 강화학습(Reinforcement Learning from Human Feedback)

- 인간의 질문에 대한 Assistant의 이상적 답변을 토대로 한 강화학습(Reinforcement Learning on Conversation)

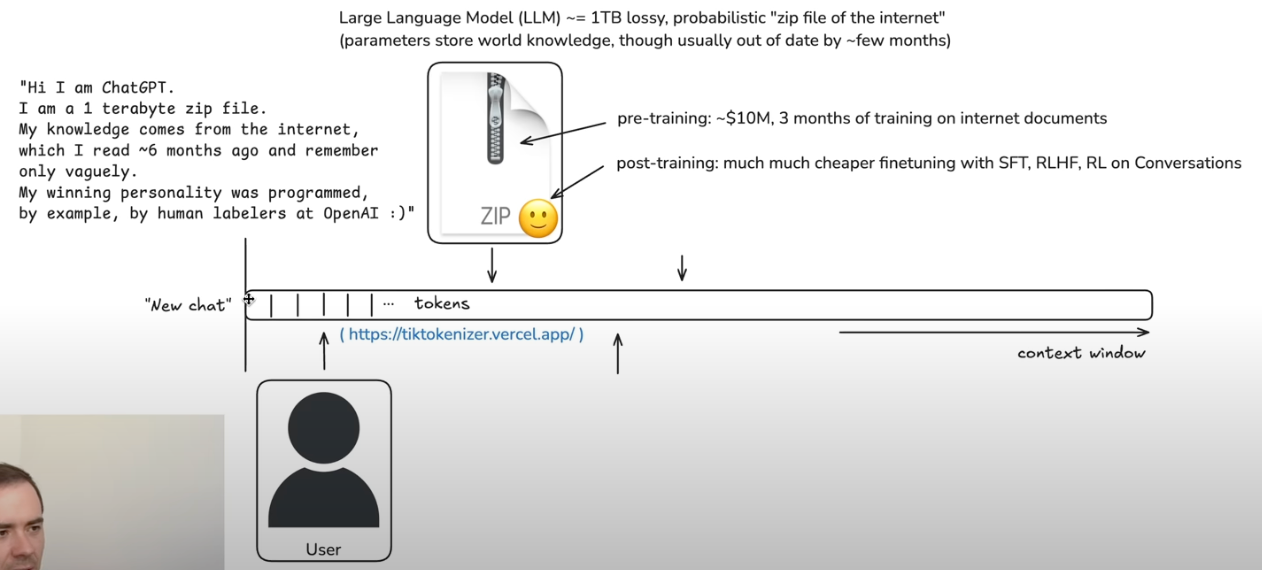

ChatGPT에서 새 세션을 만들어 유저가 메시지를 입력하면 그게 토큰화되어 모델의 인풋으로 들어가고, 그걸 통해 LLM이 다음 토큰을 만듦. 그리고 이 대화(유저의 입력, ChatGPT의 출력)는 모두 Context Window 안에 저장됨.

Context Window는 인간의 작업기억(Working Memory)와 유사하며, 인간과 마찬가지로 한계가 있음. Context Window가 길어질수록 부정확한 정보를 줄 가능성이 조금 더 높아지고, 다음 답변 생성도 조금 더 비싸짐(= 느려짐). 따라서 꼭 필요하지 않다면 한 세션을 오래 유지하는 게 그리 좋은 선택은 아님